-

There are 3 datanode(s) running and 3 node(s) are excluded in this operation

{

“dfs.nameservices”: “nameservice1”,

“dfs.ha.namenodes.nameservice1”: “nn1,nn2”,

“dfs.namenode.rpc-address.nameservice1.nn1”: “bigdata2:8020”,

“dfs.namenode.rpc-address.nameservice1.nn2”: “bigdata6:8020”,

“dfs.client.failover.proxy.provider.nameservice1”: “org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider”

} -

Hadoop 2.6.0版本起,HDFS客户端与datanode间通信的身份认证可通过启用SASL来实现。

如果datanode侧开启了SASL,那么在datax的job描述文件里,加上下面这个配置就可以了:

值需要参照hdfs-site.xml

“hadoopConfig”: { “dfs.data.transfer.protection”: “authentication”,

“dfs.encrypt.data.transfer”:true,

“dfs.block.access.token.enable”:true } -

字段顺序必须和大数据表字段顺序一致

-

hdfswriter在win环境下去调用linux的hadoop由于目录分隔符问题,在hdfs上新建的临时目录会变为win下的\,一旦写入出错,datax会删除有用的主目录,造成数据文件丢失。

-

Hadoop本身的用户和组的关系,都是同步Linux系统中的,但是HDFS和Linux的超级用户组又有一点差别,HDFS中的超级用户组是supergroup,但是Linux中默认是没有supergoup这个组,这个时候只需要在Linux中增加supergroup这个组,然后将要在HDFS中加入到supergroup中的用户加到这个组中,再同步HDFS用户和组即可。

-

Mechanism level: Failed to find any Kerberos tgt

Kerberos认证失败:没有添加-Djava.security.krb5.conf=/hadoop/xdata/krb5.conf -

hive的jdbc服务hiveserver2服务不稳定,容易掉线

解决办法:在hive的配置文件hive-site.xml中开启hiveserver2服务的高可用,即掉线了会马上再开启一个,配置如下

hive.server2.active.passive.ha.enable

true

还掉线就只能手动再启动一次hiveserver2服务了,jps查看应该是有两个RunJar进程的,一个hive的元数据服务,一个hiveserver2服务,如果只有一个就是掉了,要重启

计算机辅助药物设计

密码学

数据标注

DEFI

intellij-idea

自动控制

记事本

python学习资料

数码管

通识

弹性伸缩

游戏策划

论文

上位机

前端酒店管理系统

GDAL

默认浏览器

死锁

模型转换

替换-删除-格式化

datax连tdh写数问题记录

相关文章

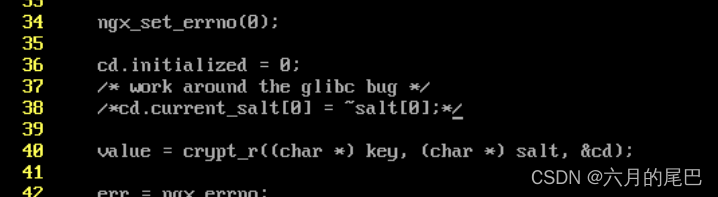

Nginx make报错处理

文章目录 make报错:fatal error:sys/sysctl.h:No such file or directory问题处理 make 报错:error: this statement may fall through [-Werrorimplicit-fallthrough]问题处理 make报错:error: struct crypt_data has no member named curre…

软件测试八股文,软件测试常见面试合集【附答案】

PS:加上参考答案有几十万字,答案就没有全部放上来了,高清打印版本超过400多页,评论区留言直接获取 1、你的测试职业发展是什么?

2、你认为测试人员需要具备哪些素质

3、你为什么能够做测试这一行

4、测试的目的是什么?

5、测…

【2023华为OD笔试必会25题--C语言版】《10 相同数字的积木游戏》——数组

本专栏收录了华为OD 2022 Q4和2023Q1笔试题目,100分类别中的出现频率最高(至少出现100次)的25道,每篇文章包括原始题目 和 我亲自编写并在Visual Studio中运行成功的C语言代码。 仅供参考、启发使用,切不可照搬、照抄,查重倒是可以过,但后面的技术面试还是会暴露的。✨✨…

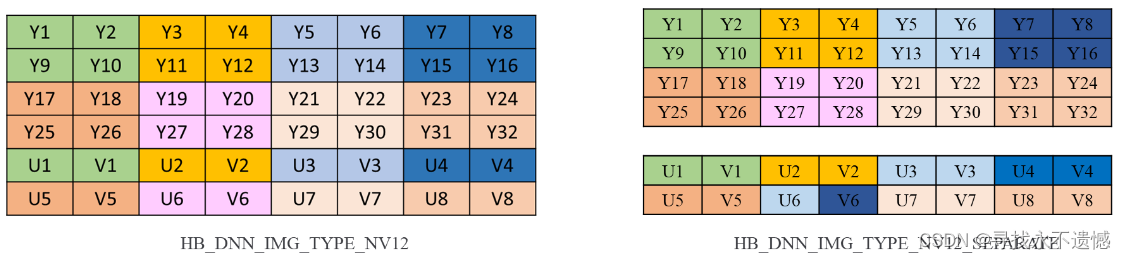

【图像基础知识】常见图像格式

文章目录 1 简介2 RGB3 BGR4 YUV4.1 YUV常见格式4.2 YUV420详解4.3 NV12 5 Gray6 图像格式之间的转换7 参考链接 原文来自于地平线开发者社区,未来会持续发布深度学习、板端部署的相关优质文章与视频,如果文章对您有帮助,麻烦给点个赞&#x…

Chapter8:线性系统的状态空间分析与综合(上)

第八章:线性系统的状态空间分析与综合 Exercise8.1

已知控制系统结构图如下所示: 其中: u u u为输入, y y y

【Kafka】Kafka3.3.1集群搭建指南KRaft版本

目录

一、背景和描述

二、资源情况

三、技术选型

四、部署Kraft版本集群

五、配置SSL模式

参考资料 一、背景和描述

考虑资源安全性,需要搭建不依赖Zookeeper的kafka集群环境,并且配置SSL访问控制

Apache Kafka Raft 是一种共识协议,…

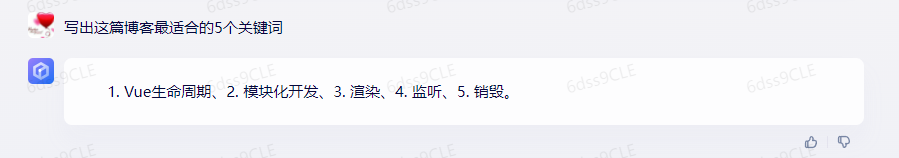

【AI大模型智慧办公】用《文心一言》1分钟写一篇博客简直yyds

文章目录 前言文心一言是什么文心一言可以做什么文心一言写博客申请体验写在最后 前言

当今社会,博客已成为了许多人分享观点、知识和经验的重要平台。用文心一言写博客是将自己的思考、想法和经验以文字的形式呈现出来,让更多人了解自己。通过写博客&a…